ตามหลักการทั่วไปแล้ว “ถ้าคุณไม่ต้องการให้ข้อมูลของคุณถูกนำไปใช้ ก็ควรเลือกที่จะไม่ให้ข้อมูลนั้นเลย”

เรากล่าวว่า “หากข้อมูลของคุณถูกเก็บรวบรวมอยู่แล้ว การควบคุมวิธีการนำข้อมูลไปใช้จึงสมเหตุสมผลกว่า”

คำถามไม่ได้อยู่ที่ว่า "บริษัทต่างๆ ควรมีข้อมูลของฉันหรือไม่?" (เพราะพวกเขามีอยู่แล้ว)

คำถามที่แท้จริงคือ “ข้อมูลของฉันควรช่วยสร้าง AI ที่ดีขึ้นสำหรับทุกคนหรือไม่?”

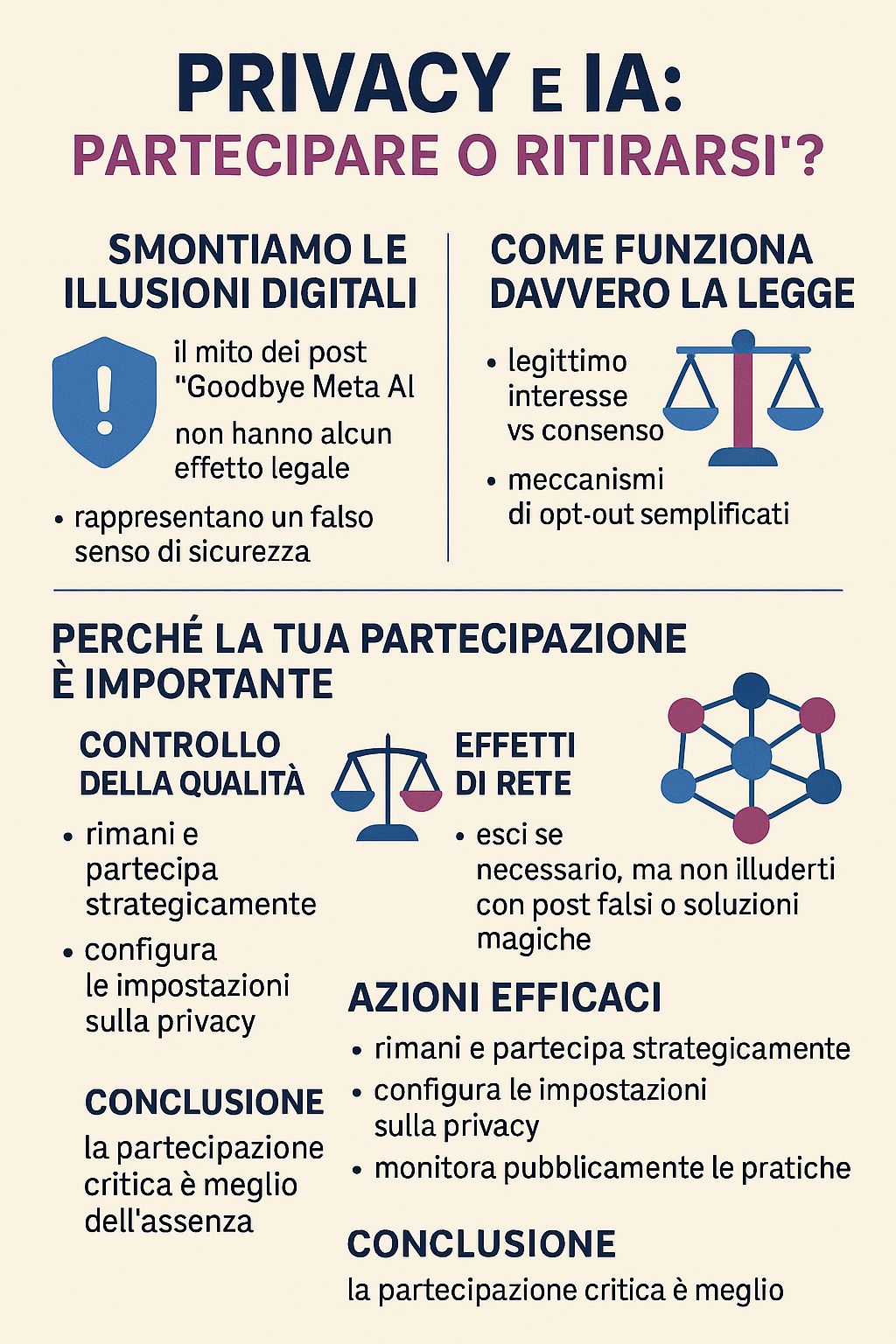

ก่อนที่จะสร้างข้อโต้แย้งที่จริงจัง จำเป็นอย่างยิ่งที่จะต้องทำลาย ภาพลวงตาอันตราย ที่แพร่กระจายอยู่บนโซเชียลมีเดีย นั่นคือโพสต์ไวรัล "Goodbye Meta AI" ที่สัญญาว่าจะปกป้องข้อมูลของคุณเพียงแค่แชร์ข้อความ

ความจริงที่น่าอึดอัดใจ: โพสต์เหล่านี้เป็นของปลอมทั้งหมด และอาจทำให้คุณ ตกเป็นเหยื่อได้ง่ายขึ้น

ตามที่ Meta เองได้อธิบายไว้ว่า "การแชร์ข้อความ 'Goodbye Meta AI' ไม่ถือเป็นการแสดงออกถึงการต่อต้านที่ถูกต้อง" โพสต์เหล่านี้:

ความสำเร็จอย่างรวดเร็วของโพสต์เหล่านี้เผยให้เห็นปัญหาที่ลึกกว่านั้น: เราชอบความคิดแบบง่ายๆ ที่เต็มไปด้วยความหวัง มากกว่าการตัดสินใจที่ซับซ้อนและรอบรู้ การ แชร์โพสต์ทำให้เรารู้สึกมีอำนาจโดยไม่ต้องใช้ความพยายามในการทำความเข้าใจอย่างแท้จริงว่าสิทธิทางดิจิทัลของเราทำงานอย่างไร

แต่ การปกป้องความเป็นส่วนตัวนั้นไม่ได้ใช้แค่มีม มันต้องใช้ความรู้และการกระทำอย่างมีสติ

ตั้งแต่วันที่ 31 พฤษภาคม 2568 เป็นต้นไป Meta ได้นำระบบใหม่สำหรับการฝึกอบรม AI มาใช้ โดยใช้ "ผลประโยชน์ที่ชอบด้วยกฎหมาย" เป็นพื้นฐานทางกฎหมายแทนการขอความยินยอม นี่ไม่ใช่ช่องโหว่ แต่เป็นเครื่องมือทางกฎหมายที่บัญญัติไว้ใน GDPR

ผลประโยชน์ที่ชอบด้วยกฎหมาย ช่วยให้บริษัทต่างๆ สามารถประมวลผลข้อมูลได้โดยไม่ต้องขอความยินยอมอย่างชัดแจ้ง หากพวกเขาสามารถแสดงให้เห็นว่าผลประโยชน์ของตนไม่ได้เหนือกว่าสิทธิของผู้ใช้ สิ่งนี้สร้างพื้นที่สีเทาที่บริษัทต่างๆ "ปรับใช้กฎหมาย" ผ่านการประเมินภายใน

การใช้ข้อมูลที่ไม่ปกปิดตัวตนนั้นมีความเสี่ยงสูงต่อ "การพลิกกลับแบบจำลอง การรั่วไหลของหน่วยความจำ และช่องโหว่ในการดึงข้อมูล" พลังการคำนวณที่จำเป็นหมายความว่ามีเพียงผู้ที่มีความสามารถสูงเท่านั้นที่สามารถใช้ประโยชน์จากข้อมูลนี้ได้อย่างมีประสิทธิภาพ ซึ่งก่อให้เกิดความไม่สมดุลในระบบ ระหว่างประชาชนและบริษัทขนาดใหญ่

เมื่อเราได้ชี้แจงข้อเท็จจริงทางกฎหมายและทางเทคนิคแล้ว ตอนนี้เรามาสร้างเหตุผลสนับสนุนการมีส่วนร่วมเชิงกลยุทธ์กันเถอะ

เมื่อผู้ที่มีความรู้ความสามารถเลือกที่จะถอนตัว AI จะฝึกฝนระบบโดยใช้ข้อมูลจากผู้ที่ยังคงอยู่ คุณต้องการให้ระบบ AI พึ่งพาข้อมูลจากผู้คนที่มีลักษณะดังต่อไปนี้เป็นหลัก:

ความลำเอียงใน AI เกิดขึ้นเมื่อข้อมูลการฝึกฝนไม่เป็นตัวแทนที่เหมาะสม การมีส่วนร่วมของคุณจะช่วยให้มั่นใจได้ว่า:

ระบบ AI จะพัฒนาดีขึ้นเมื่อมีขนาดและความหลากหลายมากขึ้น:

หากคุณใช้ฟีเจอร์ที่ขับเคลื่อนด้วย AI (การค้นหา การแปล การแนะนำ เครื่องมือช่วยการเข้าถึง) การมีส่วนร่วมของคุณจะช่วยปรับปรุงฟีเจอร์เหล่านั้นให้ดียิ่งขึ้นสำหรับทุกคน รวมถึงผู้ใช้ในอนาคตที่ต้องการฟีเจอร์เหล่านั้นมากที่สุด

ความเป็นส่วนตัวของคุณจะไม่เปลี่ยนแปลงอย่างมีนัยสำคัญระหว่างการเลือกใช้ AI และการเลือกที่จะไม่ใช้ AI ข้อมูลชุดเดียวกันนี้ถูกนำไปใช้ในงานต่างๆ อยู่แล้ว ได้แก่:

ความแตกต่าง อยู่ที่ว่าข้อมูลนี้มีส่วนช่วยในการพัฒนา AI สำหรับทุกคนหรือไม่ หรือเป็นเพียงการตอบสนองผลประโยชน์ทางการค้าในระยะสั้นของแพลตฟอร์มเท่านั้น

นี่คือเหตุผลว่าทำไมคนที่มีความรับผิดชอบอย่างคุณถึงควรมีส่วนร่วม การเกษียณอายุไม่ได้หยุดยั้งการพัฒนา AI เพียงแต่ทำให้คุณไม่มีส่วนร่วมในกระบวนการนี้เท่านั้น

ระบบ AI จะถูกพัฒนาต่อไปอย่างแน่นอน คำถามคือ จะพัฒนาต่อไปโดย อาศัยการมีส่วนร่วมของมนุษย์ที่ไตร่ตรองประเด็นเหล่านี้อย่างมีวิจารณญาณหรือไม่?

เข้าใจได้ แต่ลองพิจารณาดู: คุณอยากให้ระบบ AI ถูกสร้างขึ้น โดยมี หรือ ไม่มี ส่วนร่วมจากผู้คนที่มองบริษัทขนาดใหญ่ในแง่ลบเหมือนคุณมากกว่ากัน?

ความไม่ไว้วางใจของคุณนั่นแหละคือเหตุผลสำคัญที่ทำให้การมีส่วนร่วมอย่างมีวิจารณญาณของคุณมีค่า

ปัญญาประดิษฐ์กำลังกลายเป็นความจริง ไม่ว่าคุณจะเข้าร่วมหรือไม่ก็ตาม

สิ่งที่คุณต้องเลือกไม่ใช่ว่าจะมีการสร้าง AI หรือ ไม่ แต่ เป็นว่า AI ที่สร้างขึ้นนั้นจะสะท้อนถึงค่านิยมและมุมมองของผู้คนที่คิดอย่างรอบคอบเกี่ยวกับประเด็นเหล่านี้หรือไม่

การเลือกที่จะไม่เข้าร่วมการเลือกตั้งก็เหมือนกับการไม่ไปลงคะแนนเสียง มันไม่ได้หยุดการเลือกตั้ง เพียงแต่หมายความว่าผลการเลือกตั้งจะไม่นำความคิดเห็นของคุณมาพิจารณา

ในโลกที่เฉพาะผู้ที่มีความสามารถในการคำนวณสูงเท่านั้นที่จะสามารถตีความและใช้ประโยชน์จากข้อมูลเหล่านี้ได้อย่างมีประสิทธิภาพ เสียงวิพากษ์วิจารณ์ของคุณในระหว่างการฝึกอบรมจึงอาจมีผลกระทบมากกว่าการที่คุณไม่ปรากฏตัว

จงอยู่และมีส่วนร่วมอย่างมีกลยุทธ์หาก:

และในระหว่างนี้:

แต่อย่าหลอกตัวเองด้วย:

การที่คุณเลือกที่จะไม่เข้าร่วมนั้นมีผลกระทบต่อความเป็นส่วนตัวของคุณน้อยมาก แต่การเลือกที่จะไม่เข้าร่วมนั้นส่งผลกระทบอย่างแท้จริงต่อทุกคน

ในโลกที่ระบบ AI จะเข้ามาเปลี่ยนแปลงการไหลเวียนของข้อมูล การตัดสินใจ และปฏิสัมพันธ์ระหว่างผู้คนกับเทคโนโลยี คำถามจึงไม่ใช่ว่าระบบเหล่านี้ควรมีอยู่หรือไม่ แต่ เป็นว่าระบบเหล่านี้ควรจะรวมมุมมองของบุคคลที่มีความคิดรอบคอบและวิพากษ์วิจารณ์อย่างเช่นคุณเข้าไปด้วยหรือไม่

บางครั้ง การกระทำที่รุนแรงที่สุดไม่ใช่การยอมแพ้ บ่อยครั้ง การกระทำที่รุนแรงที่สุดคือการอยู่ต่อและทำให้แน่ใจว่าเสียงของคุณได้รับการรับฟัง

นิรนาม

ไม่ใช่เรื่องของการเชื่อใจบริษัทอย่าง blindly หรือเพิกเฉยต่อข้อกังวลด้านความเป็นส่วนตัว แต่เป็นเรื่องของการตระหนักว่าความ เป็นส่วนตัวไม่ได้ถูกปกป้องด้วยมีม แต่ด้วยการมีส่วนร่วมอย่างมีกลยุทธ์และรอบรู้

ในระบบนิเวศที่มีความเหลื่อมล้ำทางอำนาจอย่างมหาศาล เสียงวิพากษ์วิจารณ์ของคุณในด้านการฝึกอบรม AI อาจมีผลกระทบมากกว่าการที่คุณไม่เข้าร่วมประท้วง

ไม่ว่าคุณจะเลือกอะไร โปรดเลือกอย่างมีสติ ไม่ใช่เลือกด้วยภาพลวงตาทางดิจิทัล

ขอแสดงความเห็นใจต่อ "ผู้ที่ปลีกตัวจากโลกออนไลน์เพื่อความเป็นส่วนตัว" ด้วยเช่นกัน — บรรดาผู้มีจิตใจบริสุทธิ์ที่เชื่อว่าพวกเขาสามารถหลีกเลี่ยงการติดตามทางดิจิทัลได้อย่างสมบูรณ์โดยการใช้ชีวิตแบบออฟไลน์เหมือนพระสงฆ์ทิเบตในปี 2025

คำเตือน: ต่อให้คุณอาศัยอยู่ในกระท่อมห่างไกลในเทือกเขาโดโลไมต์ ข้อมูลของคุณก็อยู่ทุกที่แล้ว แพทย์ประจำตัวของคุณใช้ระบบดิจิทัล ธนาคารที่คุณฝากฟืนไว้ก็ติดตามทุกธุรกรรม ซูเปอร์มาร์เก็ตในท้องถิ่นมีกล้องวงจรปิดและระบบชำระเงินอิเล็กทรอนิกส์ แม้แต่บุรุษไปรษณีย์ที่นำบิลมาให้คุณก็มีส่วนร่วมในชุดข้อมูลด้านโลจิสติกส์ที่ป้อนข้อมูลให้กับอัลกอริธึมการปรับปรุงประสิทธิภาพ

การปลีกตัวจากโลกดิจิทัลอย่างสิ้นเชิงในปี 2025 หมายถึง การตัดขาดตัวเองจากสังคม โดยสิ้นเชิง คุณอาจเลิกใช้ Instagram ได้ แต่คุณไม่สามารถเลิกใช้บริการด้านสุขภาพ การธนาคาร การศึกษา หรือการจ้างงานได้โดยไม่ส่งผลกระทบอย่างรุนแรงต่อคุณภาพชีวิตของคุณ

ในขณะที่คุณกำลังสร้างกระท่อมที่ทนทานต่อ 5G ข้อมูลของคุณก็ยังคงอยู่ ในฐานข้อมูลของโรงพยาบาล ธนาคาร บริษัทประกันภัย เทศบาล และหน่วยงานจัดเก็บภาษี และยังคงถูกนำไปใช้ในการฝึกอบรมระบบที่จะส่งผลต่อคนรุ่นต่อไปในอนาคต

ปรากฏการณ์ความขัดแย้งของฤๅษี: การที่คุณปลีกตัวออกไปประท้วงไม่ได้ป้องกันไม่ให้ระบบ AI ถูกฝึกฝนด้วยข้อมูลจากผู้คนที่มีความรู้ไม่มากนัก แต่กลับทำให้คุณไม่สามารถมีอิทธิพลต่อการพัฒนาระบบเหล่านั้นไปในทิศทางที่ถูกต้องตามหลักจริยธรรมได้

โดยสรุปแล้ว คุณได้พิชิตความบริสุทธิ์ทางศีลธรรมอันล้ำเลิศของผู้ที่เฝ้ามองประวัติศาสตร์จากบนอัฒจันทร์ ในขณะที่คนอื่นๆ—ผู้ที่รู้แจ้งน้อยกว่าแต่มีส่วนร่วมมากกว่า—เป็นผู้กำหนดกฎเกณฑ์ของเกม

ไม่ว่าคุณจะเลือกอะไร โปรดเลือกอย่างมีสติ ไม่ใช่เลือกด้วยภาพลวงตาทางดิจิทัล

บทความที่อ้างอิง:

ข้อมูลเชิงลึกเกี่ยวกับ GDPR และผลประโยชน์ที่ชอบด้วยกฎหมาย:

แหล่งข้อมูลอย่างเป็นทางการ:

สำหรับขั้นตอนการดำเนินการที่เป็นรูปธรรม: หากคุณอยู่ในยุโรป โปรดตรวจสอบขั้นตอนการยกเลิกการยินยอมอย่างเป็นทางการกับหน่วยงานคุ้มครองข้อมูลของอิตาลี สำหรับข้อมูลทั่วไป โปรดตรวจสอบการตั้งค่าความเป็นส่วนตัวและข้อกำหนดในการให้บริการของแพลตฟอร์มของคุณ และโปรดจำไว้ว่า: โพสต์บนโซเชียลมีเดียใดๆ ก็ไม่มีผลทางกฎหมาย